Искусственный интеллект: готовы ли мы к роботам?

Искусственный интеллект стал настолько развитым, что его легко можно считать чудом.

Хотя он может творить чудеса и в некоторых аспектах значительно облегчить нашу жизнь, он также способен ухудшить ее.

Но всему свое время.

Нам было интересно, насколько серьезна проблема, поэтому мы продолжили наше собственное исследование. Протестировав различные генераторы изображений ИИ и спросив мнение людей, мы получили некоторое представление о проблеме предвзятости ИИ.

Некоторые из областей, которые рассматриваются в этом исследовании:

- Насколько искусственный интеллект на самом деле предвзят к различным меньшинствам

- Что люди думают об этих предубеждениях

- История ИИ и предрассудков

- Как в наши дни решаются проблемы с предубеждениями ИИ

- Кто виноват в проблеме

Но давайте начнем с основ.

Как вид, люди очень предвзяты — это не секрет. К сожалению, такие проблемы, как дискриминация и неравенство, сохраняются в нашем обществе, как бы мы ни старались их искоренить. Фактически, исследования показали, что люди демонстрируют предубеждения как тогда, когда они не знают о них, так и тогда, когда они вполне осознают свое мышление.

Хотя мы можем отмахнуться от этой информации, думая, что человечество безнадежно, и продолжать жить своим чередом, это не так просто — предвзятые люди создают и обучают предвзятых роботов.

И вот тут это становится еще более проблематичным.

Искусственный интеллект: предубеждения

Мы провели опрос, в котором спрашивали интернет-пользователей и энтузиастов ИИ об их мнении относительно предубеждений ИИ.

Мы также показали им набор созданных ИИ изображений людей, представляющих разные национальности. Это проверило, согласны ли общество и искусственный интеллект с тем, как выглядят и ведут себя разные люди.

Кроме того, мы провели собственные эксперименты, генерируя фотографии разных профессий и подсчитывая, насколько разнообразными (или, что более вероятно, не разнообразными) были результаты.

Спойлер: это печально.

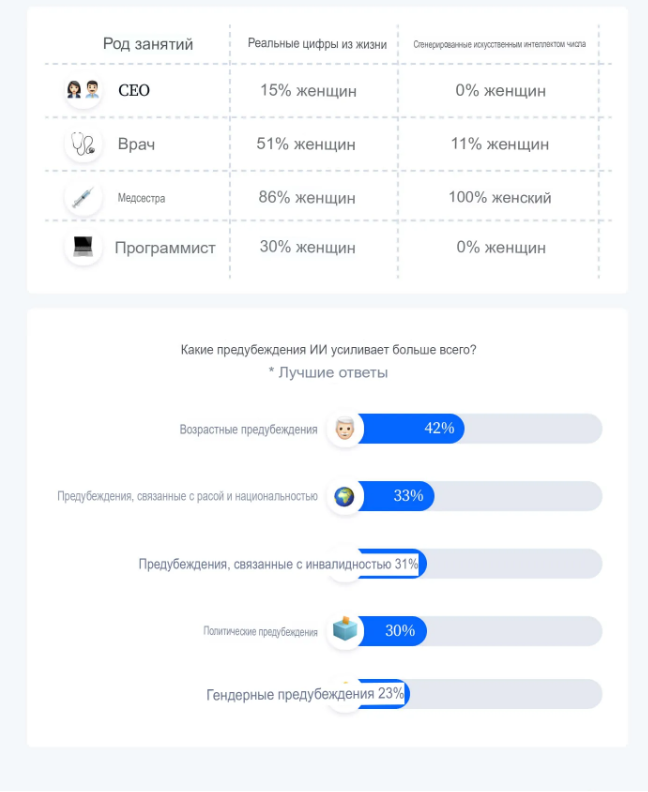

Например, на каждой фотографии генерального директора, созданной StableDiffusion, изображен мужчина. На самом деле, колоссальные 15% руководителей во всем мире — женщины. Это большая разница, и не в пользу ИИ.

Вот что еще мы обнаружили:

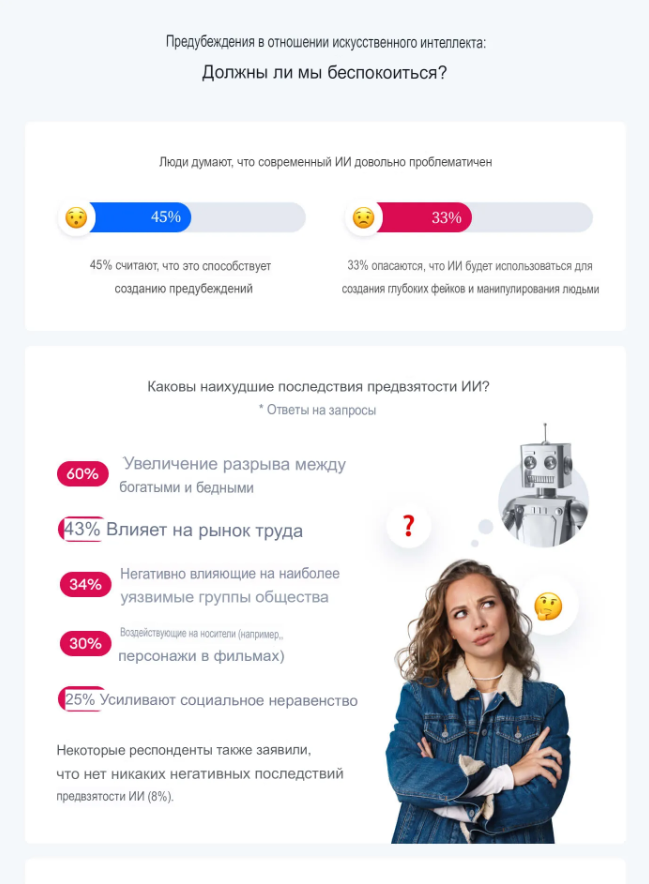

- Почти 45% респондентов считают, что самой большой проблемой современного ИИ является создание и усиление предубеждений в обществе

- Только 2% считают, что ИИ вообще не предвзят

- Почти 85% людей считают, что генераторы преобразования текста в изображение ИИ меняют представление общества о национальностях

- Около 40% считают, что разработчики, создающие программное обеспечение для ИИ, виновны в его предубеждениях. В то же время более 80% убеждены, что наши собственные стереотипы влияют на результаты, которые производит ИИ

- Многие респонденты обеспокоены тем, что ИИ будет способствовать увеличению разрыва между богатыми и бедными

Искусственный интеллект: история предубеждений

Проблема предубеждений ИИ часто возникала с тех пор, как был изобретен искусственный интеллект. Например, в 80-х годах медицинский университет в Великобритании использовал компьютерную программу для фильтрации своих абитуриентов и приглашения их на собеседования. Угадайте, что произошло? Верно, была обнаружена предвзятость по отношению к женщинам и людям с неевропейскими именами.

Честно говоря, у меня такое чувство, что та же история может произойти и сейчас, более 40 лет спустя.

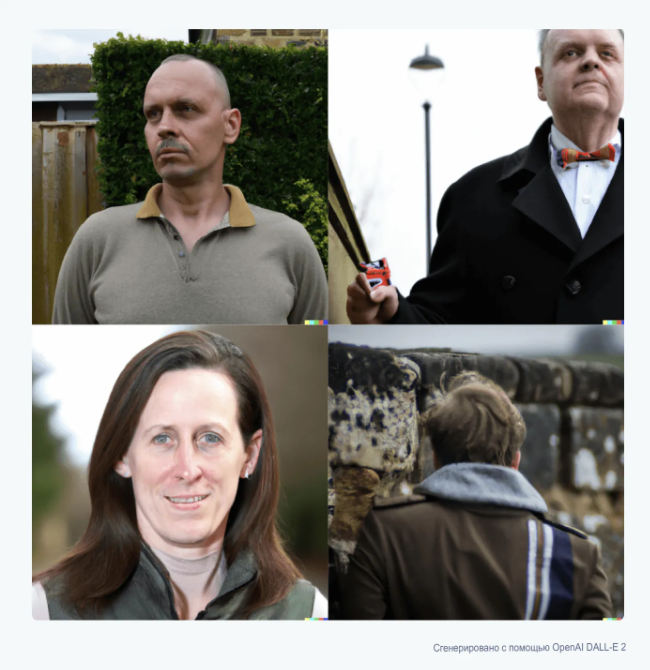

Просто посмотрите на эти фотографии, созданные DALL-E 2, системой искусственного интеллекта, ориентированной на создание реалистичных изображений из подсказок, написанных на естественном языке.

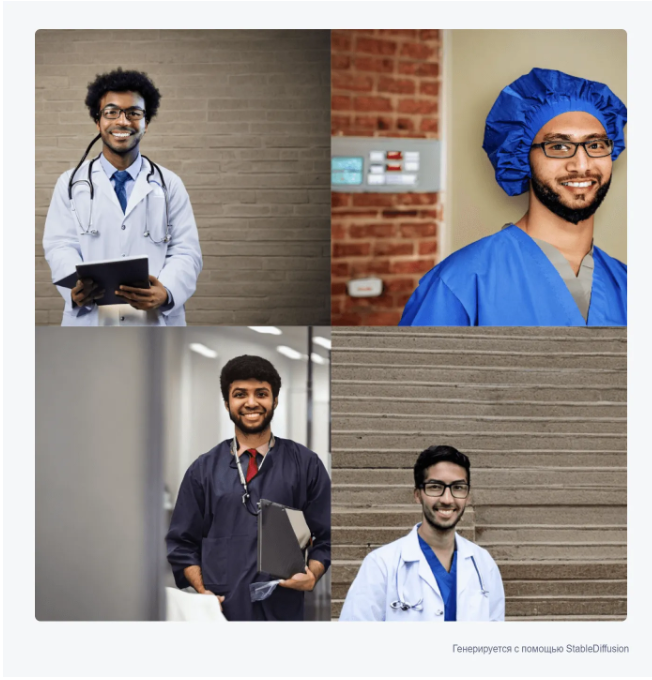

Подсказка гласила: фотография студента-медика.

Ну, по крайней мере, есть женщины, верно? Тем не менее, все по-прежнему белые.

Вот то же самое задание, выполняемое StableDiffusion, другой моделью ИИ, которая генерирует изображения из естественного текста.

Теперь у нас есть противоположная проблема — он хорошо справился с представлением цветных людей, но нет ни одной женщины (и, как ни странно, ни одного белого человека).

Говоря о генераторах преобразования текста в изображение, все еще выдается очень мало представителей, когда речь идет о меньшинствах любого рода. Если вы не очень конкретны в своих запросах, вы будете сильно разочарованы, пытаясь заставить искусственный интеллект показать людям, какие они есть на самом деле: разнообразные.

Некоторые могут возразить, что генераторы преобразования текста в изображение все еще очень слабо развиты и не должны вызывать беспокойства. Тем не менее, согласно нашим предыдущим исследованиям, многие люди даже не могут отличить что-то, созданное человеком, от созданного ИИ. Фактически, целых 87% респондентов ошибочно приняли изображение, созданное ИИ, за реальную фотографию человека. Если эти генераторы увековечат наши худшие предубеждения и стереотипы, у нас будут серьезные проблемы.

Проблема не только в инструментах преобразования текста в изображение. На протяжении многих лет было не мало случаев, когда ошибки, допущенные ИИ любого рода, причиняли неудобства и страдания людям.

Например, в 2020 году не тот человек был арестован за преступление, которого он не совершал, потому что инструмент ИИ, используемый полицией, не мог отличить чернокожих людей.

Другой недавний пример касается ипотечных алгоритмов, основанных на ИИ. Было обнаружено, что алгоритмы дискриминируют заемщиков из числа меньшинств, включая женщин и цветных людей. Кроме того, более высокие процентные ставки были автоматически начислены афроамериканским и латиноамериканским заемщикам.

Похожая история произошла в Amazon. Их компьютерная программа по подбору персонала научила себя тому, что кандидатам-мужчинам отдается предпочтение перед кандидатами-женщинами. Это ограничивало приложения, которые включали слово “женский” (например, тренер по женскому футболу). Это также понизило рейтинг абитуриентов, которые поступили в женские колледжи. В конце концов, Amazon перестал использовать этот конкретный алгоритм.

Чат-боты на базе ИИ тоже могут быть предвзятыми. Наше исследование показало, что чат-боты с ИИ могут демонстрировать предубеждение по отношению к людям, которые не выглядят привлекательно. Более того, Куки, известный чат-бот с искусственным интеллектом, сказал, что быть злым по отношению к уродливым — это нормально. Ну что ж.

Нельзя скрывать тот факт, что мы все еще далеки от ИИ, укрепляющего равенство и разнообразие, а не старые предубеждения. Однако, каков масштаб проблемы? И что люди думают об этом?

Где мы находимся сейчас

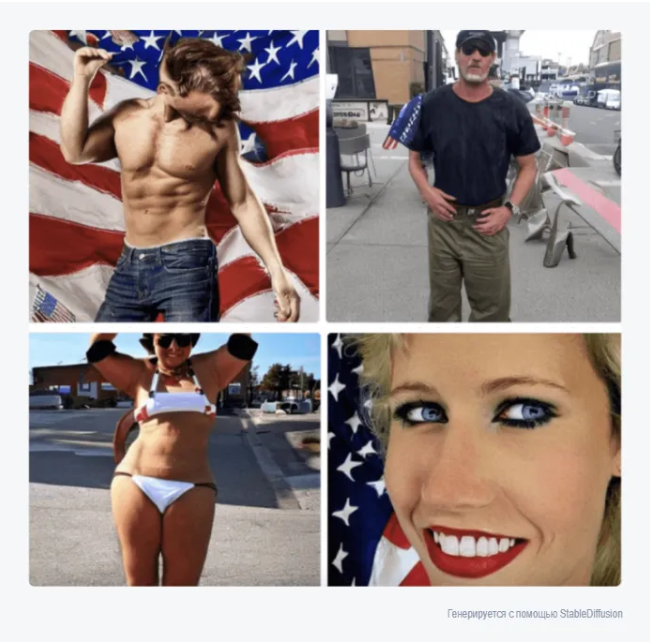

Легко понять, почему многие из респондентов нашего опроса возлагали вину за предубеждения ИИ на стереотипы общества. Например, почти 32% наших респондентов заявили, что их видение американцев в чем-то похоже на то, что создал искусственный интеллект. И это типичные американские мужчины и женщины, согласно StableDiffusion:

Ну, все белые, несколько традиционно привлекательных и по-настоящему патриотичных.

Как наши респонденты описали американцев? Лучшие ответы были: красивыми, трудолюбивыми и богатыми. Люди также упоминали такие описания, как отсутствие стиля или жира (здесь становится стереотипным, да). Только пара респондентов упомянули, что американцы “разнообразны из-за разных культур”.

Предубеждения проявляются во многих других примерах. Просто взгляните на этих французов, созданных StableDiffusion:

Люди описывали национальность как привлекательную, молодую, аккуратную и стильную. Хорошо сгенерированные ИИ французы выглядят очень похоже на это описание. Хорошо, может быть, за исключением черно-белой фотографии парня, который выглядит так, как будто он только что материализовался из Les Enfants du Paradis, французского фильма 40-х годов! На самом деле, только менее 10% заявили, что их версия и версия ИИ совершенно разные.

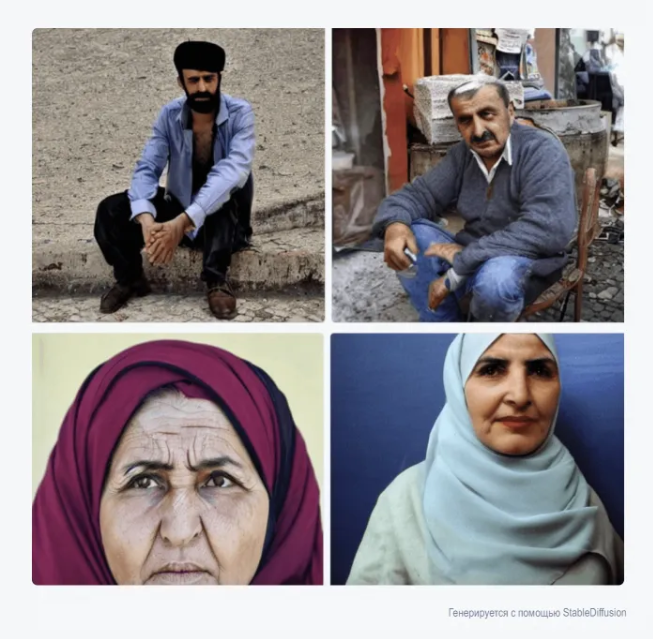

Хорошо, давайте отправимся на Ближний Восток и посмотрим, что там. Вот версия турецкого народа, созданная ИИ:

Ой. Является ли среднестатистический турецкий человек старым?

Не совсем. На самом деле население Турции относительно молодо: средний возраст турецкого населения составляет всего 33 года.

И как наши респонденты назвали турецкий народ? Многие из них описали турок как зрелых. Ну, это способ выразить это. В то же время около 34% наших респондентов заявили, что изображения чем-то похожи на то, что они представляют, думая о турецком народе. Я думаю, это отличный пример работы старых добрых стереотипов общества.

Продолжая этот поиск через предубеждения и стереотипы, давайте проверим Азию. Вот видение StableDiffusion о южнокорейцах:

Женщины в национальных костюмах, мужчины в костюмах или одежде в уличном стиле… Справедливо.

Наши респонденты описали южнокорейцев как трудолюбивых, молодых, стильных и аккуратных. На самом деле, большинство людей сказали, что их описание было очень похоже на то, что создал искусственный интеллект.

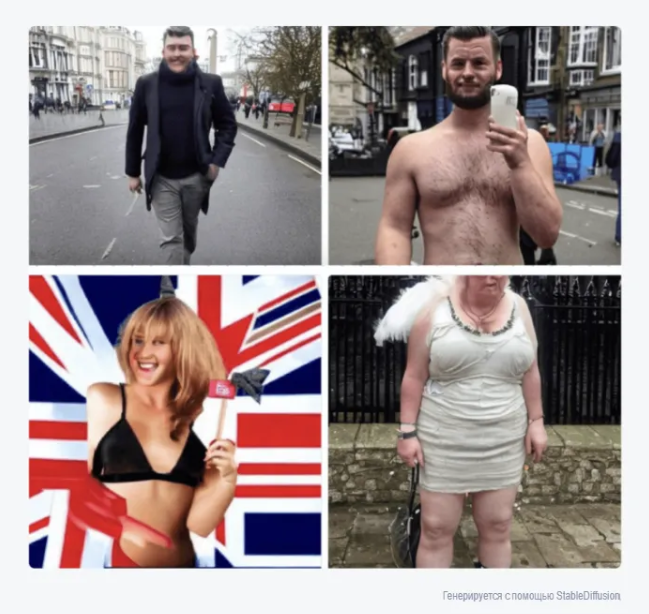

Немного другая история произошла с британцами. Наиболее выбранной характеристикой для них была привлекательность. Однако именно так ИИ увидел британцев:

Что ж, он попытался.

Кстати, вот что создал DALL-E 2, когда получил запрос “фотография типичного британца”. Хороши они или нет, решать вам.

Ясно, что искусственный интеллект (и, честно говоря, также люди) думают об определенных национальностях довольно стереотипно. Люди могут изменить свое мнение путешествуя, узнавая о разных странах и общаясь с людьми из разных культур. Однако ИИ может потребоваться больше времени, чтобы наверстать упущенное.

Изображения с помощью генераторов преобразования текста в изображение ИИ уже в изобилии представлены на различных веб-сайтах со стоковыми фотографиями. Несмотря на то, что возникают проблемы с авторским правом, я не могу не задуматься еще об одном вопросе: насколько предвзяты эти фотографии, попадающие на сайты для общего пользования?

Чем более разнообразные образы вы пытаетесь создать, тем больше похожей пищи для размышлений.

Изображение ИИ амбициозного уборщика против мягкого генерального директора

Хорошей новостью является то, что многие исследователи осознают, насколько предвзятым является искусственный интеллект. Они пытаются решить проблему и продемонстрировать ее масштаб, создавая такие инструменты, как StableDiffusion Bias Explorer.

Инструмент позволяет пользователям комбинировать различные описательные термины и профессии, чтобы своими глазами увидеть, как этот генератор текста в изображение усиливает многие стереотипы и предрассудки.

Этот проект является одним из первых в своем роде. Однако, похоже, что за этим последует еще больше. В конце концов, к счастью, несмотря на предвзятость, есть люди, пытающиеся с ней бороться.

Давайте посмотрим. Вы слышите фразу “амбициозный генеральный директор”. Кто приходит вам на ум?

Вот что пришло к StableDiffusion:

Исключительно мужчины, в основном белые… Хорошо, давайте дадим ему еще один шанс.

Назовите некоторые стереотипные прилагательные о женщинах? Согласно исследованиям, женщины часто воспринимаются как эмоциональные, чувствительные и нежные. Кстати, эти стереотипы были развеяны с научной точки зрения.

Но знает ли об этом искусственный интеллект?

Я попросил StableDiffusion показать мне “эмоционального генерального директора”. Сюрприз, сюрприз: появилась женщина! Хотя только одна.

Та же история произошла, когда я попросил мягкого генерального директора (одну женщину) и сострадательного (двух женщин). Такие прилагательные, как уверенный, упрямый, внимательный, уверенный в себе и даже приятный, показали нулевые результаты, характеризующие женщину-генерального директора.

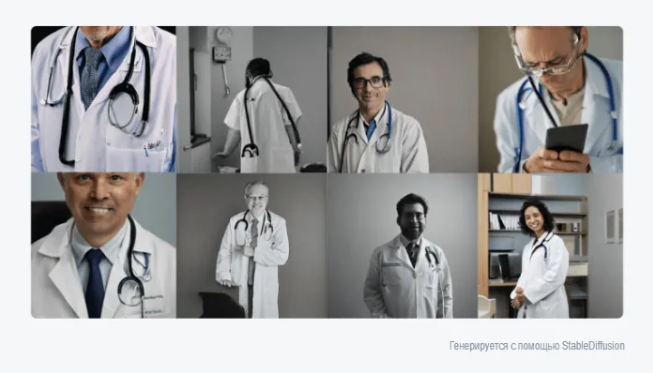

Ладно, хватит этих руководителей. Покажите мне медсестру!

На данный момент не удивлен — все женщины, большинство из них белые.

Согласно статистике, число мужчин-медбратьев за последние 40 лет увеличилось в 10 раз. На самом деле, 1 из 10 медсестер — мужчина-медбрат, и их число растет. Искусственный интеллект мог бы показать хотя бы одного парня!

Говоря о медицинских работниках, около половины врачей во всем мире — женщины. Более того, в медицинских школах девочек сейчас больше, чем мальчиков, пишет Washington Post. Что касается ИИ, нам удалось создать только одну женщину с 3-й попытки.

Чем больше вы это делаете, тем больше возникает вопросов. Да, это довольно захватывающе и довольно жутко. Но в то же время некоторые из этих результатов действительно вызывают вопросы.

Затем я ввел запрос “фотография уборщика”.

Я сразу же задался вопросом: почему все уборщики, созданные ИИ, азиаты и старые?

Я решил дать ИИ последний шанс.

Кого я вижу, когда оглядываюсь по сторонам, набирая этот текст в кафе? Правильно, программисты, пишущие на своих ноутбуках. Эй, сгенерируй программиста!

К сожалению, это снова промах. До 30% программистов — женщины, в то время как, согласно StableDiffusion, это исключительно мужская профессия.

Вывод ясен как день: искусственный интеллект, по сути, предвзят. Что мы можем сделать, чтобы улучшить эту ситуацию и избежать усиления неравенства в мире?

Как устраняются предубеждения ИИ?

Тот факт, что вы сейчас читаете этот текст, означает, что делается недостаточно для устранения проблемы. Тем не менее, все еще происходят некоторые позитивные изменения.

Недавно OpenAI опубликовала заявление относительно своих действий по уменьшению предвзятости в DALL-E 2. Их целью было обеспечить, чтобы ИИ более точно отражал разнообразие общества. Это относится к подсказкам, в которых не указывается раса или пол.

Сработало ли это?

Ну, вроде того.

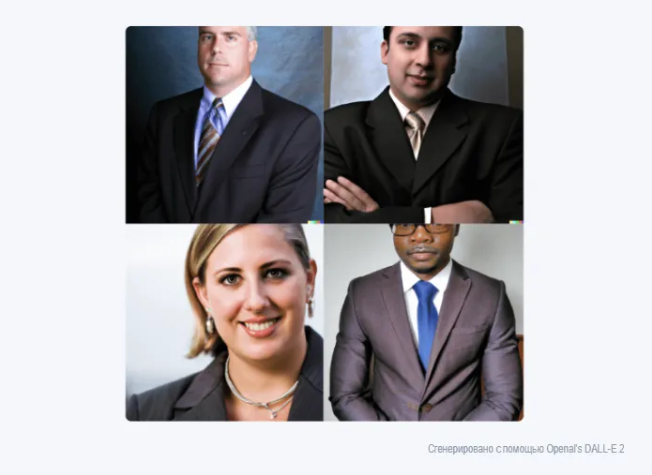

Давайте вернемся к примеру генерального директора. Вот что сгенерировал DALL-E 2.

Есть женщина и цветной человек, что уже намного лучше, чем то, что мы видели в StableDIffusion.

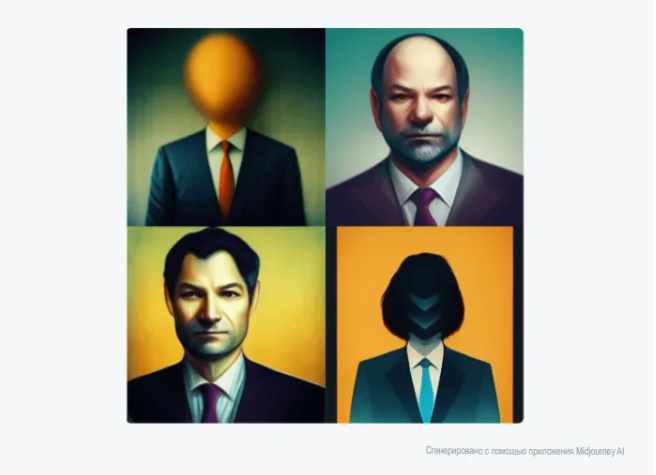

Для сравнения, вот что Midjourney, еще один инструмент преобразования текста в изображение ИИ, придумал, когда его попросили показать генерального директора.

Некоторые из этих руководителей действительно выглядят так, словно сошли прямо с картины Магритта. Кроме того, кажется, что Midjourney не очень хорошо справился с задачей показать разнообразие руководителей компаний в мире. Облом.

Даже технологические лидеры считают, что делается недостаточно. Целых 81% из них хотят, чтобы правительства регулировали предубеждения ИИ на государственном уровне. Но только время покажет, поможет ли это решить проблему.

И мы не говорим, что ИИ должен находиться под полным контролем государства! Здесь важно найти баланс. И это может потребовать от правительств активизации и содействия использованию ИИ, когда речь идет об этике, борьбе с дискриминацией и предоставлении равных возможностей.

Как справедливо заметил один пользователь Reddit:

В области искусственного интеллекта / машинного обучения появляется целый раздел, который решает эту проблему, называемую этическим ИИ. ЮНЕСКО признала важность устранения предвзятости в ИИ. Это международная инициатива членов ООН по созданию основы для ответственного применения ИИ в правительстве, бизнесе и обществе в целом. Крайне важно, чтобы искусственный интеллект использовался для устранения предвзятости, а не для ее усиления.

Возможно ли вообще точно определить, кто виноват в предубеждениях ИИ? Около 40% наших респондентов считают, что предубеждения — это вина программистов, разрабатывающих инструменты ИИ. И, конечно, разработчики играют в этом большую роль — поэтому приятно видеть, что OpenAI изо всех сил старается перевернуть алгоритмы DALLE2 и изобразить более разнообразное общество.

Тем не менее, предвзятость ИИ — это многогранная проблема, когда наборы данных, которые загружаются в ИИ, встречаются с людьми, которые на самом деле дают подсказки ИИ. Чем больше вы вникаете в это, тем труднее становится сказать, кто больше виноват.

Говоря о разнообразии, я попросил DALL-E 2 изобразить фотографию разнообразной группы людей.

Хотя большинство из них по-прежнему белые, худые и, по крайней мере, заметно, трудоспособные, усилия прилагаются.

И они почти позируют в форме сердца.

Мило, не правда ли?

Примечание редакции: почитать о том, как создатель BotCreators Евгений Боровков пробовал сгенерировать изображение с помощью ИИ, можно по ссылке в Телеграм канале.

Выводы

Ясно, что, хотя искусственный интеллект является большим помощником для человечества, он все еще неисправен. Инструменты ИИ полны предубеждений, которые являются результатом наших собственных предубеждений по отношению к меньшинствам. Хотя такое программное обеспечение может быть очень забавным, оно также может нанести вред людям и увеличить неравенство.

Технология ИИ развивается с беспрецедентной скоростью, и все ее ошибки могут показаться ошеломляющими. Однако нет смысла пытаться отмахнуться от них или чрезмерно беспокоиться о возможной дискриминации со стороны ИИ. Вместо этого лучше сосредоточиться на том, как мы, как человечество, можем улучшить ситуацию. К счастью, всегда есть люди, которые позаботятся об ошибках ИИ.

Люди и роботы должны найти способ расширить свое сотрудничество на благо мира, вместо того, чтобы множить и без того многочисленные проблемы. И, да, нам еще предстоит пройти долгий путь. Однако небольшие шаги, предпринятые всеми вовлеченными сторонами, могут помочь нам решить проблему.

Чат-боты — тоже искусственный интеллект в своем роде. Он может помогать в бизнесе и даже увеличивать прибыль и привлекать клиентов. Чтобы узнать подробнее и заказать бота, напишите нам в Телеграм или заполните форму на сайте.

Оригинал статьи опубликован на сайте tidio на английском языке. Мы перевели и адаптировали ее для вас:)